Hat den Golembeitrag Linux auf dem Desktop, ein Abenteuer für alle die den Alltag langweilig finden schon wer gelesen?

Alleine die Schlagzeile widerspricht allem, was ich seit Jahren erlebe, aber vielleicht war Linux Mint ja einfach nicht die richtige Wahl?

Linux auf dem Desktop – Wo ist das Problem???

Ihr wisst ja vielleicht, daß ich Linux am Dienstag moderiere. Da kämpfen wir seit Jahren mit dem Phänomen, daß wir keine Desktopthemen finden(damit ist der Desktop gemeint, nicht der PC auf dem Tisch 😉 ). Außer vielleicht gelegentlich mal über eine neue Version von einem Desktop zu berichten, geht es meistens um „Wie löse ich Aufgabe X in der Konsole“ oder „Hey, schon dieses Programm gesehen?“ . Natürlich gibt es auch dieses „OMG!“ Momente, weil wieder irgendwas nicht so läuft wie es sollte, weil eine neue Version vom Nvidia-Treiber plötzlich nicht mehr rückwärtskompatibel ist. Aber das ist natürlich auch mit Windows nicht anders 😉

Von der anderen Seite aus betrachtet, sorgen diese „OMG!“ Momente, auch für die Themen bei Linux am Dienstag wo alle mit Herzblut lauschen oder mitarbeiten, denn zum Probleme lösen sind wir bei Linux am Dienstag 🙂 und das uns genau diese Probleme ausgehen, weil „der Krempel“ einfach immer besser wird, ist das eigentliche Problem, das ich als Moderator von Linux am Dienstag mit Linux habe 😉

Privat ärgere ich mich auch über einige Dinge, zum Beispiel das man Bugs meldet und die Maintainer so genervt sind, daß sie es am Reporter auslassen oder noch schlimmer, daß sich gar keiner um das Problem kümmert. Heute möchte ich mich mal positiv darüber auslassen, wie einfach die Installation geworden ist, natürlich nur, wenn man Fedora als Distro ausgewählt hat. Selbst Schuld wenn Ihr die zu Unrecht kaum beachtete Distribution mit dem meisten Kick nicht verwendet, sondern so komischen Empfehlungen folgt, daß Linux Mint #1 wäre 😉

Die Installation mit Anaconda

Fangen wir vorn an, bei der Installation Eures neuen Linux Desktop PCs

Als erstes brauchen wir ein ISO-Image von Fedora(ISO-Image) oder alternativ https://getfedora.org besuchen.

Das Image mit einem Programm Eurer Wahl auf einen USB Stick brennen ( als Abbild, nicht einfach drauf kopieren 😉 ).

Nun den Rechner mit dem USB Stick booten und …. den Anweisungen folgen:

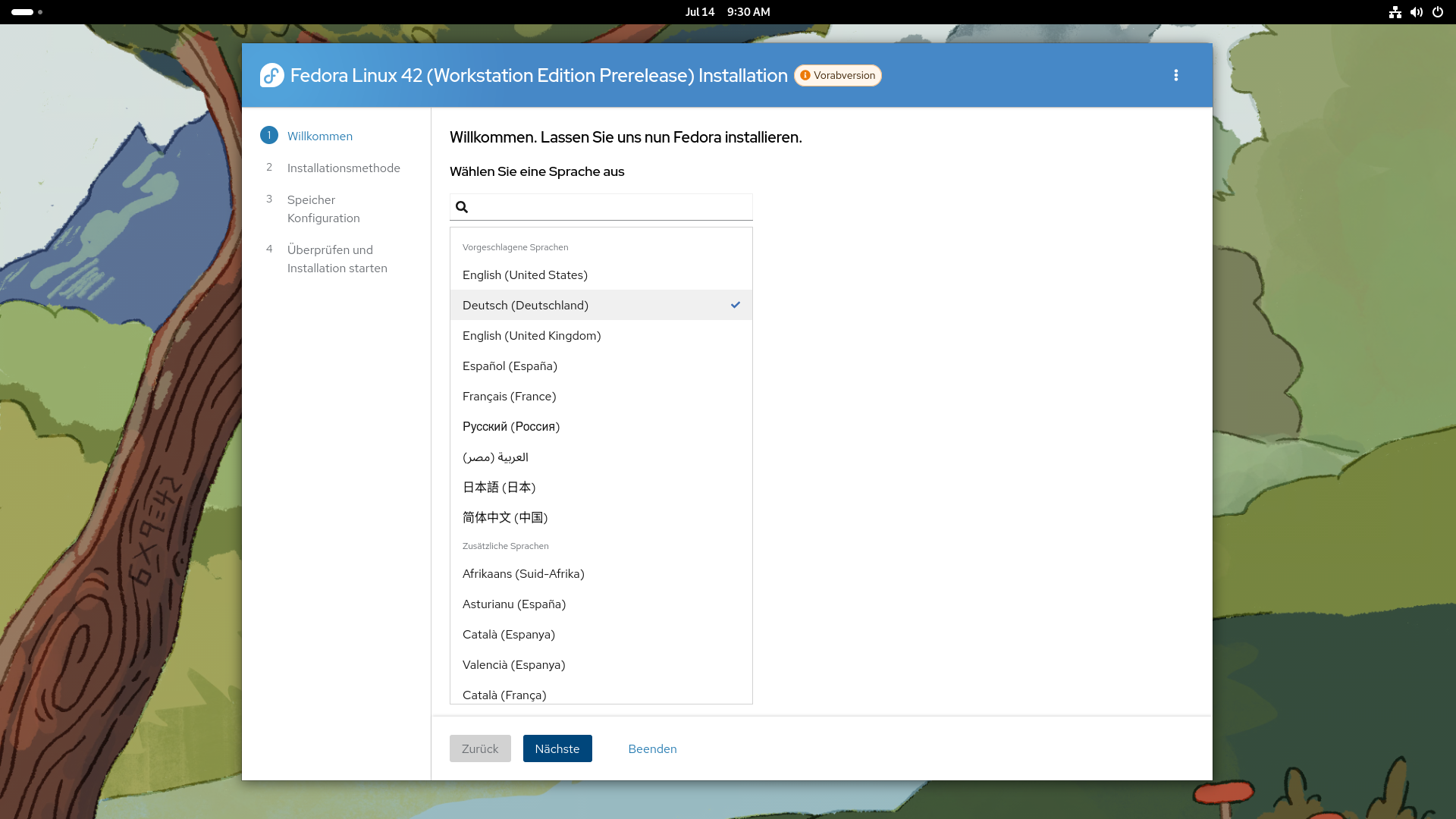

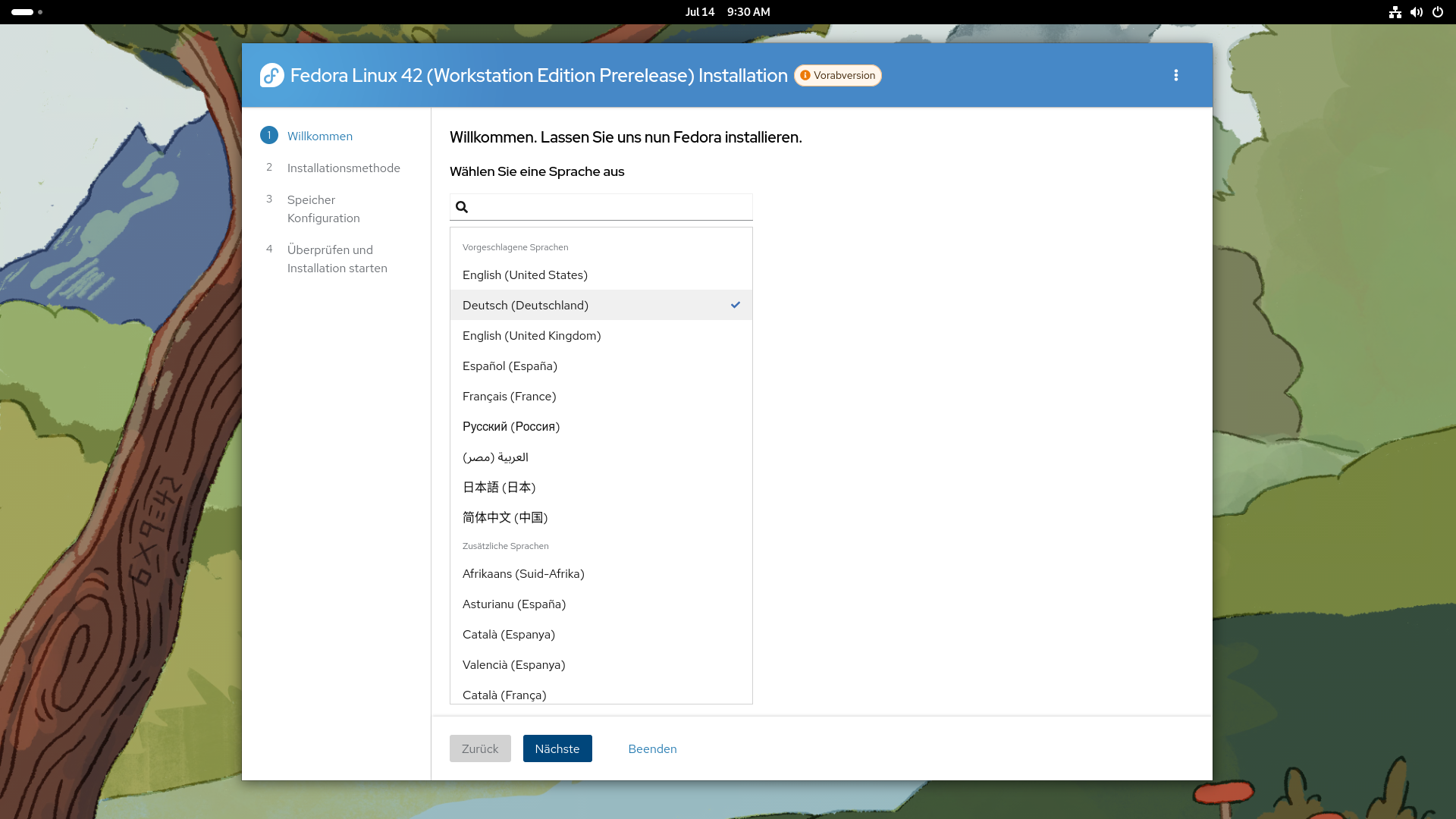

Schritt 1: Sprache auswählen – Deutsch

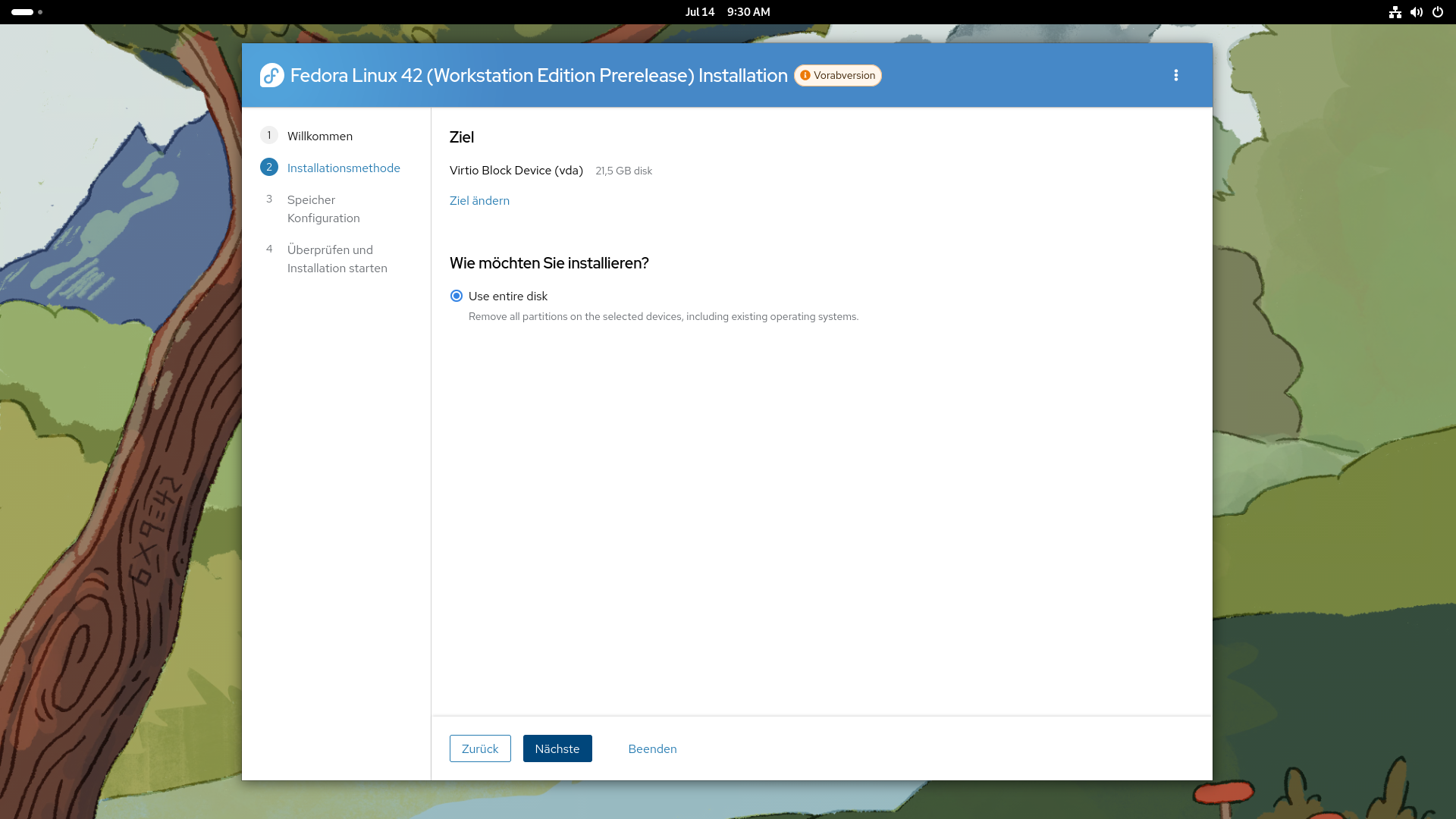

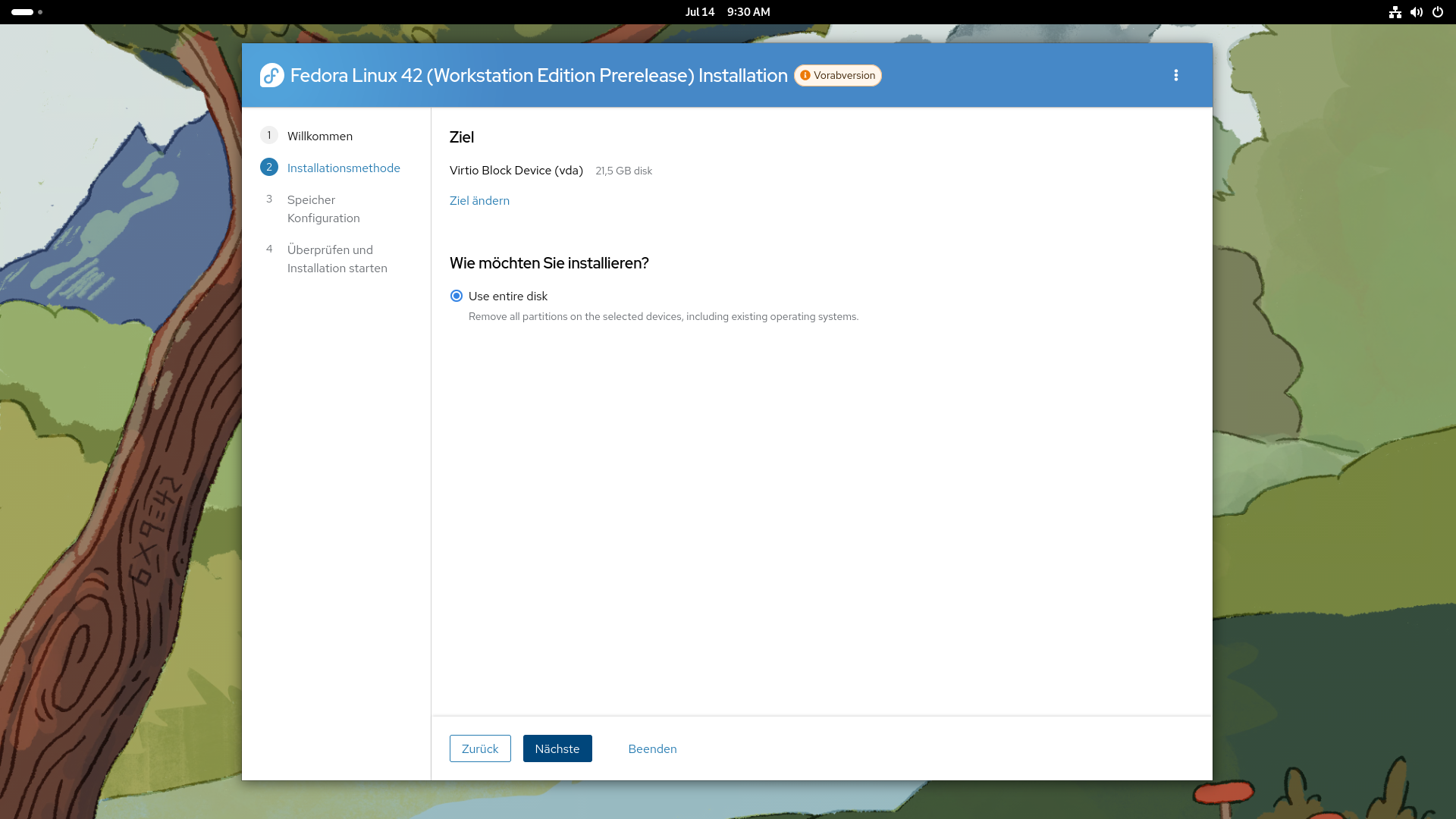

Schritt 2: Auswahl der zu benutzenden Festplatte

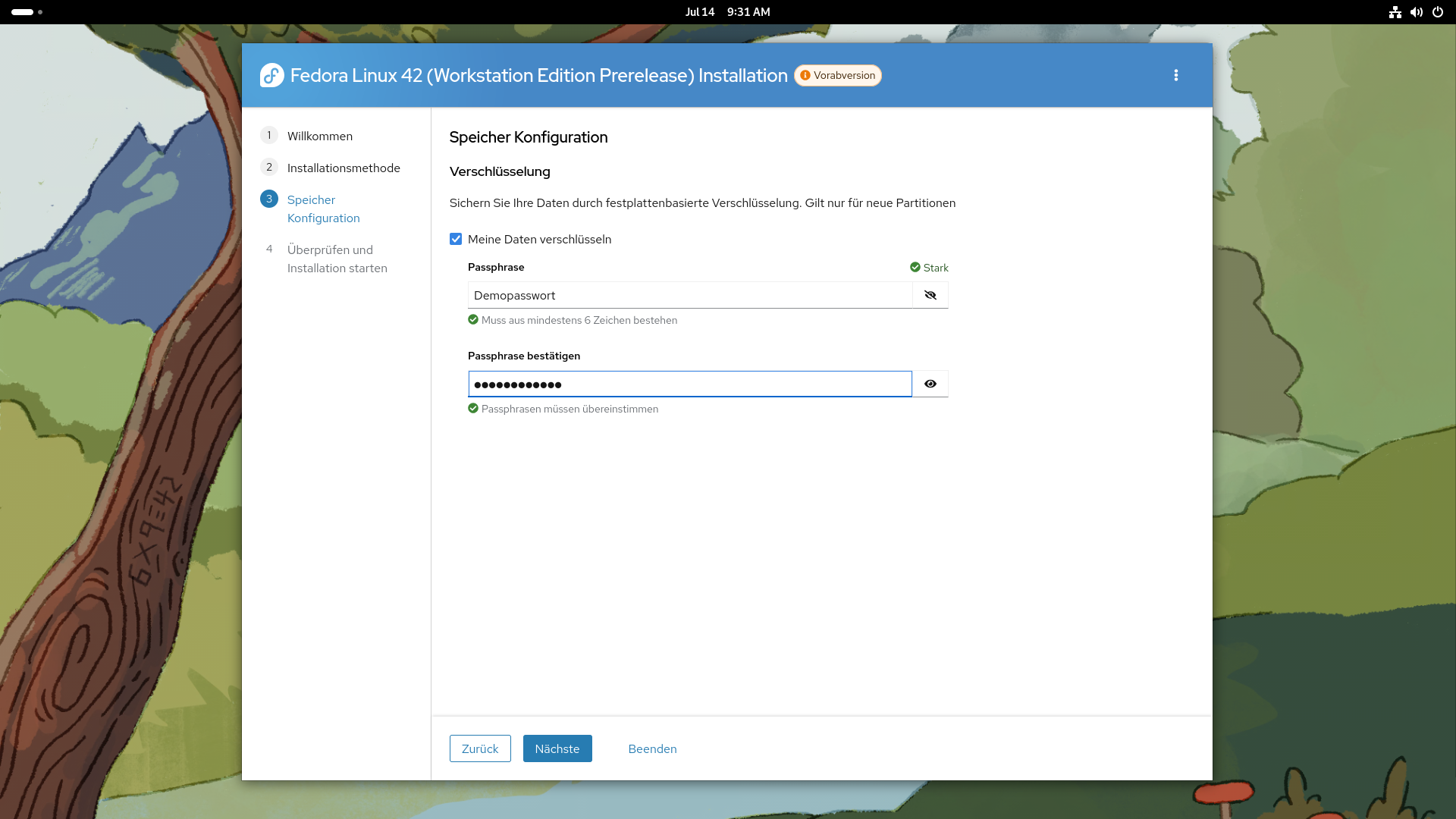

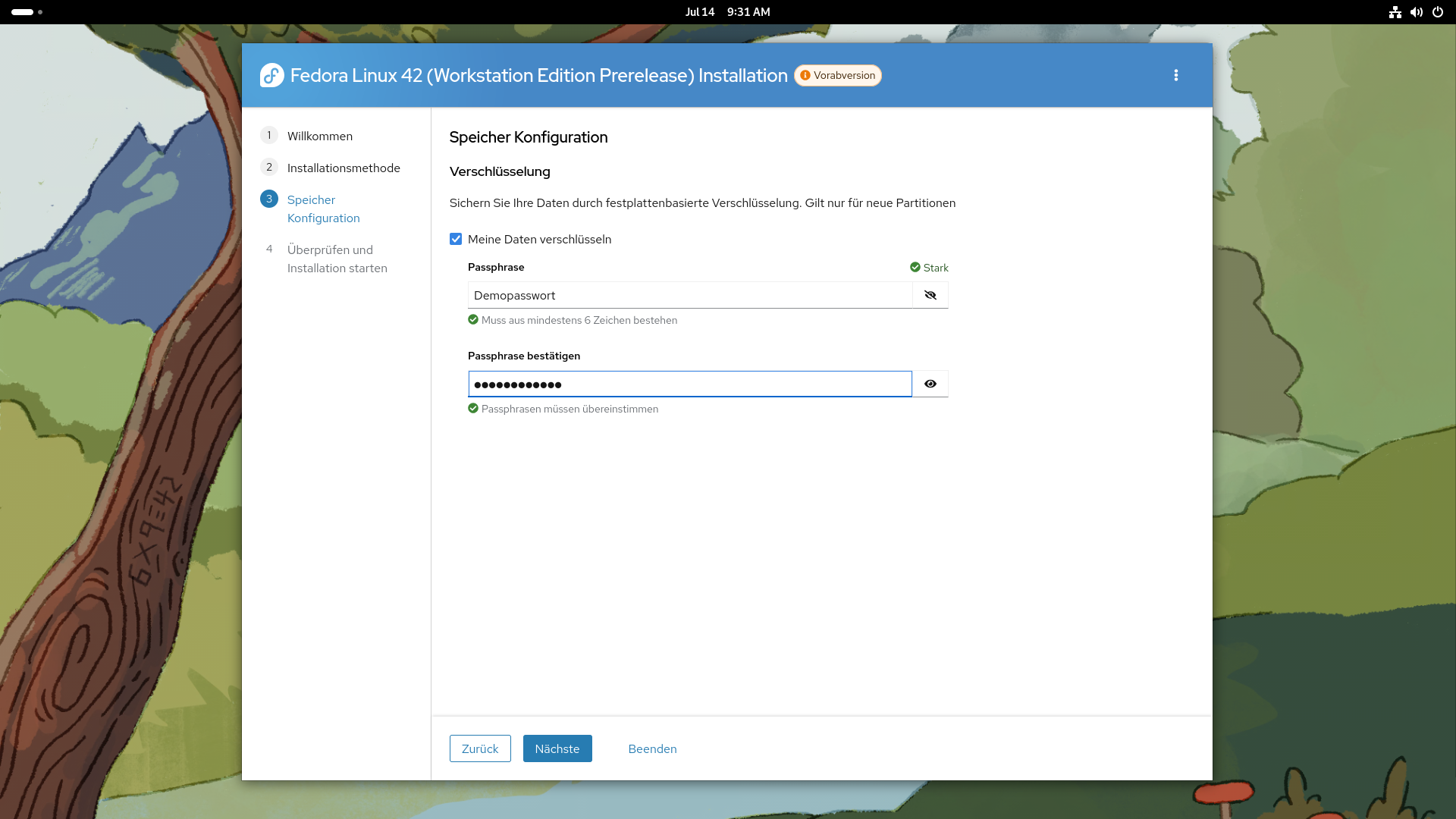

Schritt 3: Die Passworteingabe für die Festplattenvollverschlüsselung

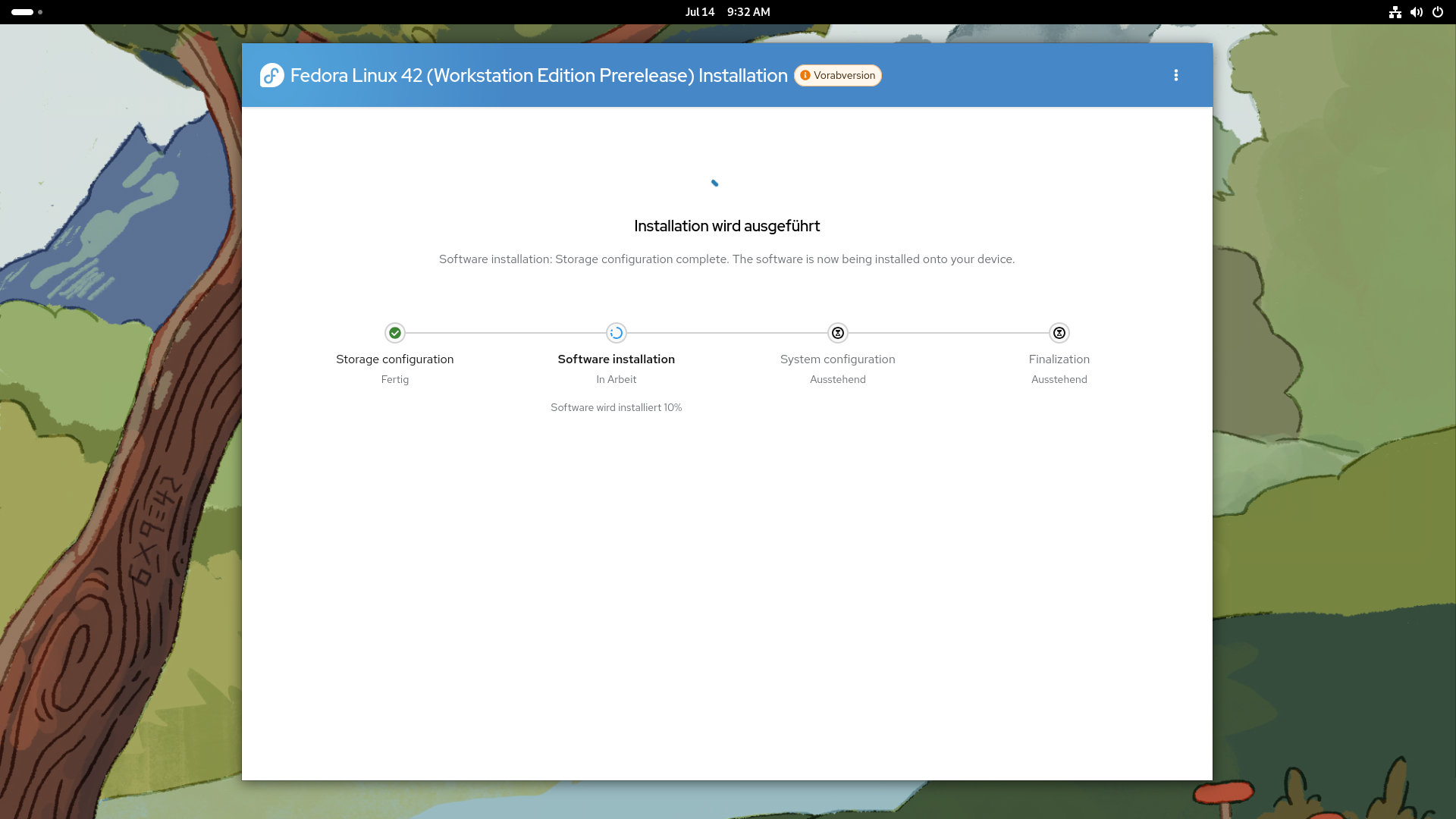

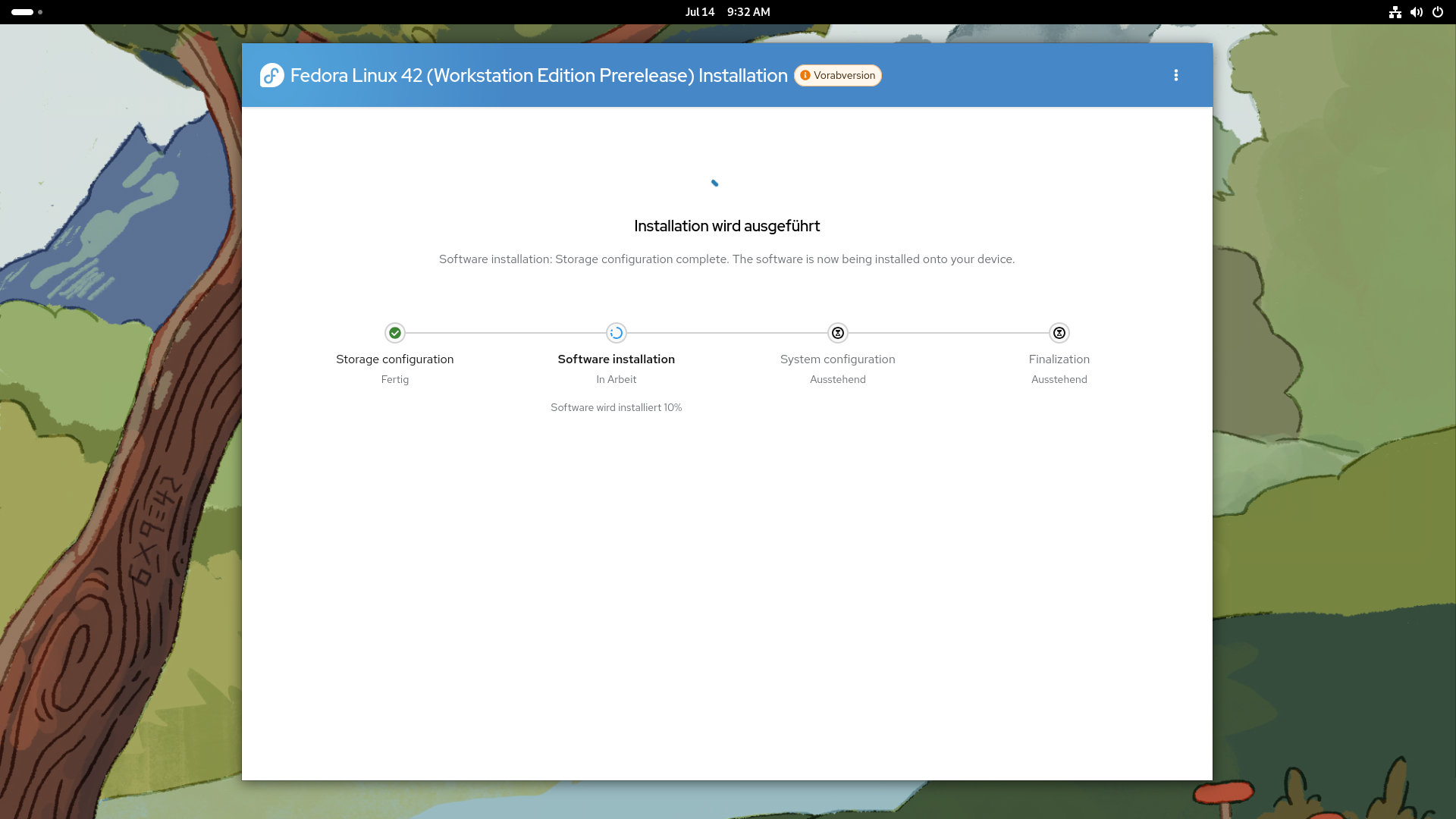

Schritt 4: Zuschauen wie die Software installiert wird.

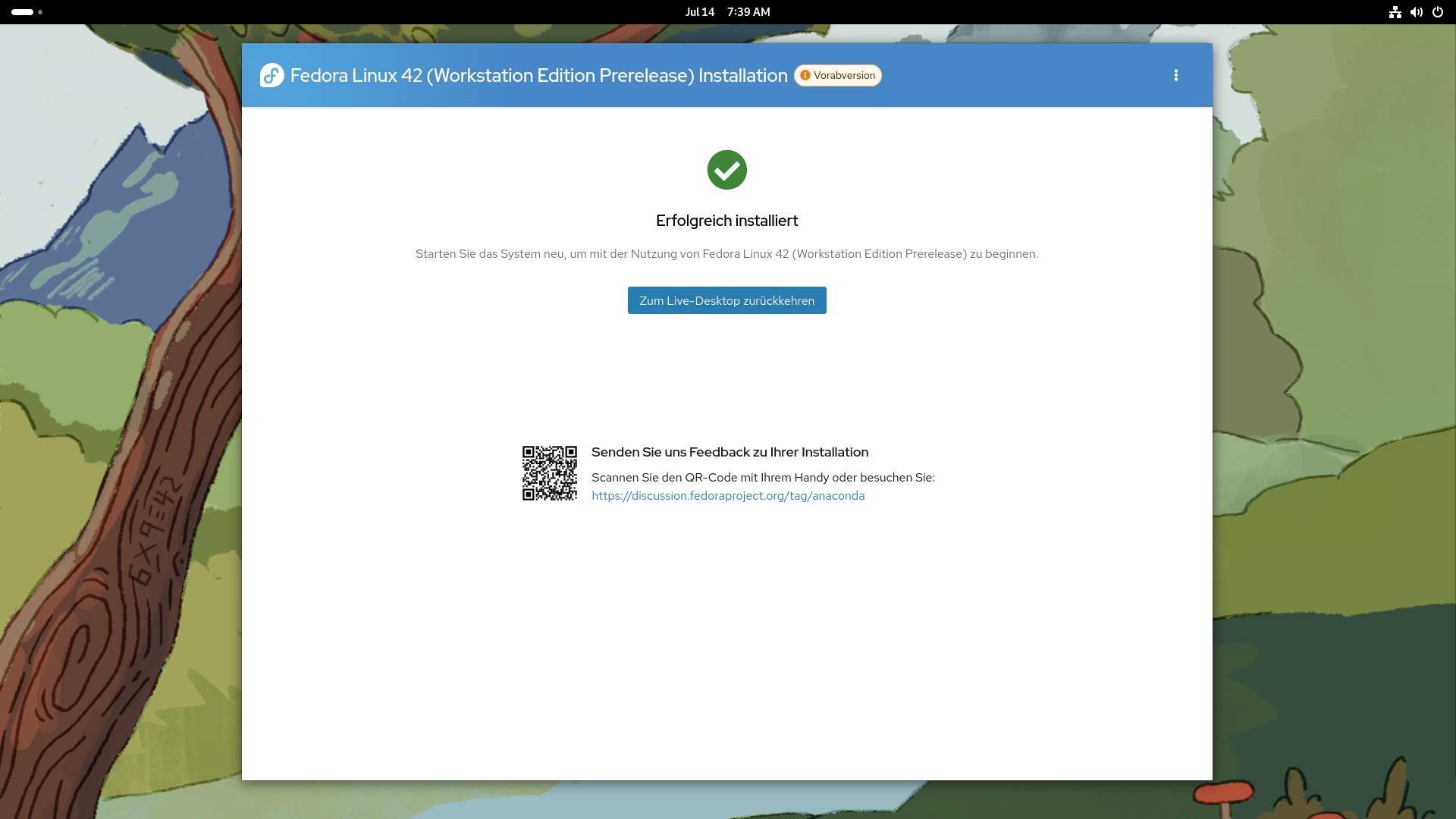

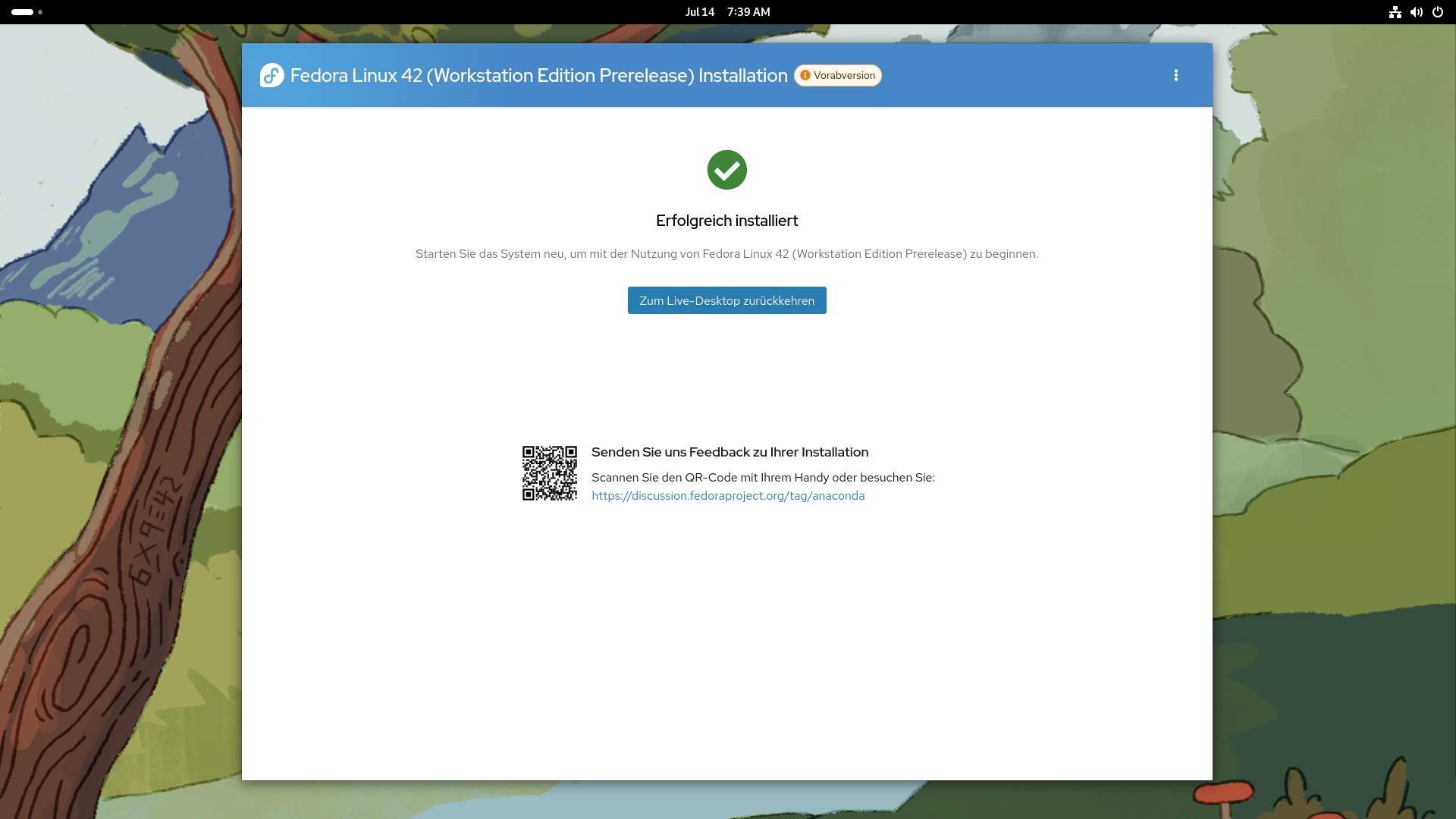

Fertig. Einmal Rebooten bitte.

War das jetzt schwer? Ich denke nicht 🙂

Nach dem Neustart

darf man als erstes seinen Zugang anlegen, also den Benutzernamen und das Passwort. Dann werden noch 2-3 Wünsche abgefragt zu Drittanbietersoftware, Fehlerberichterstattung und Geolocation-Diensten und es kann losgehen.

Firefox und Thunderbird sind schon vorinstalliert, Bildbetrachter und PDF-Viewer auch, da wird es jetzt schon eng mit den Softwarewünschen der ersten Stunde.

Was cooles passierte gerade

Die Aufnahmen für diesen Beitrag habe ich mit einer VM gemacht, die mit Gnome Boxen lief. Da ist mir mitten drin meine reale Cinnamon Sitzung zusammengebrochen und ich mußte neu einloggen. Die VM lief noch, was wichtig war, weil die gerade Updates eingespielt hat 🙂

Normalerweise liefen die VMs via Boxen genau so lange wie die Desktopsession lief, aber offenkundig werden die jetzt als Background-Dienst gestartet, also außerhalb vom Benutzerkontext. Da gabs früher schon eine Option für, aber die war standardmäßig aus. Ich sags ja: „Der Krempel wird immer besser.“ 😉

Die Desktopsession ist gestorben, weil … ja.. wieso eigentlich? Weil scheinbar eine Gnome-Shell, das ist der Gnome-Desktop, gestartet wurde, während Cinnamon noch lief und da habe ich keine Erklärung für. Geil, dann haben wir morgen ein Problem zu ergründen \o/

Seht Ihr, so kommt Linux am Dienstag zu seinen Themen 🙂 Und ich dachte schon, daß Sommerloch wäre wieder da 😉